Estimados miembros de Akasha Comunidad:

Desde hace ya varios años, comenzó a permear, primero a cuentagotas y ahora en todos lados y a todas horas, el concepto de inteligencia artificial. Desde la limitada noción de objetos inteligentes, como los teléfonos, se fue expandiendo ese concepto hacia las consolas de vídeo juegos, y poco a poco en más objetos de uso común… hasta los refrigeradores, caray, que ahora ‘saben’ cuando se acabó la leche y hasta lo piden vía internet al supermercado de manera automática. Los ojos de Alexa ahora vigilan silenciosos y sus oídos están listos para escuchar las órdenes de quien la tiene en casa y ha dejado la ardua labor de prender y apagar luces o música a aquel robot casero.

La idea de que un objeto sea inteligente se barajeó en la mente del humano desde hace tiempo. De hecho, hasta la mitología griega antigua hablaba de robots, y los egipcios y chinos llegaron a construir autómatas. ¿Por qué esta obsesión con dotar de inteligencia a un objeto? En realidad es un asunto filosófico – de acuerdo a Tania Lewis (2021) los filósofos clásicos intentaban “describir al pensamiento humano como un sistema simbólico”, y al ser un sistema, sería posible ‘recrearlo’ en un objeto, cosa que comenzaron a plantear formalmente en 1956, cuando se crea en Dartmouth College la disciplina de la ‘inteligencia artificial’ (Pueden leer más sobre esto en: https://www.livescience.com/49007-history-of-artificial-intelligence.html).

No pretendo ser conocedora del tema de la inteligencia artificial. De hecho, soy bastante ‘retro’ en ese sentido, y coincido plenamente con la sabiduría de Arthur Weasley, quien le dijo a su hija “¿No te he enseñado nada? ¿Qué es lo que siempre te he dicho? Nunca confíes en algo que puede pensar por sí mismo si no puedes ver dónde guarda su cerebro.” Sí, definitivamente no confío en (ni incluyo en mi vida diaria) Alexas, ni refrigeradores inteligentes, sensores de luz que esperan un aplauso para ser apagados, relojes que monitorean el ritmo cardíaco, ni mucho menos autos de conducción automática, y si tengo teléfono ‘inteligente’ es porque cada vez es más complicado conseguir un teléfono celular normalito, de esos que solo sirven para llamar a alguien y quedar en verse, así como hacíamos hace apenas 20 o 30 años. No me lo tomen a mal, no estoy diciendo que no tenga uso la tecnología, ¡claro que la tiene!, y mi trabajo requiere del uso de muchas y diversas tecnologías. Pero me parece que vamos en una dirección peligrosa cuando se vuelve más inteligente un objeto que un humano. Y si consideramos que la educación de los niños y jóvenes ha sido sistemáticamente erosionada en las últimas décadas, resultando en una menor capacidad de pensamiento abstracto, habilidades de razonamiento, capacidad de memoria y de interpretación y creatividad, entonces tenemos un problema.

Ayer comentó conmigo un estudiante acerca de una plataforma abierta y gratuita de ‘inteligencia artificial’ para escribir ensayos. Yo me tomo muy en serio el plagio; es, tal cual, un robo, y el internet como constante en la vida de la gente, aunado a una escasa percepción de la falta de ética de robarse ideas y palabras de otros, ha llevado a que sea práctica común en el quehacer estudiantil (y lamentablemente también a nivel profesional, en algunos casos). Soy bastante buena para detectar plagios en los trabajos de los estudiantes, a ojo y usando programas para ello, pero ahora resulta que se puede pedir a una ‘inteligencia artificial’ que desarrolle un tema específico, e incluso pedirle que lo escriba con un estilo determinado. Me dio curiosidad lo que me dijo el estudiante, y quise ver qué tan bien lo hacía esa plataforma, así que me metí y le indiqué al sistema que escribiera un ensayo sobre un tema científico: la asimetría fluctuante (que es un concepto muy relevante para la biología del desarrollo, para la ecología y hasta para la salud). Quedé impresionada: en escasos segundos había escrito cuatro párrafos del tema, usando adecuadamente los conceptos y con ejemplos relevantes. Busqué en un programa de detección de plagios y no había plagio alguno; hasta eso cuida ese sistema de inteligencia artificial. Evidentemente, como docente, estoy preocupada. ¿Cómo se va a lidiar con eso en la docencia? ¿Qué va a implicar para la formación de los estudiantes? ¿Qué va a implicar para la ciencia?

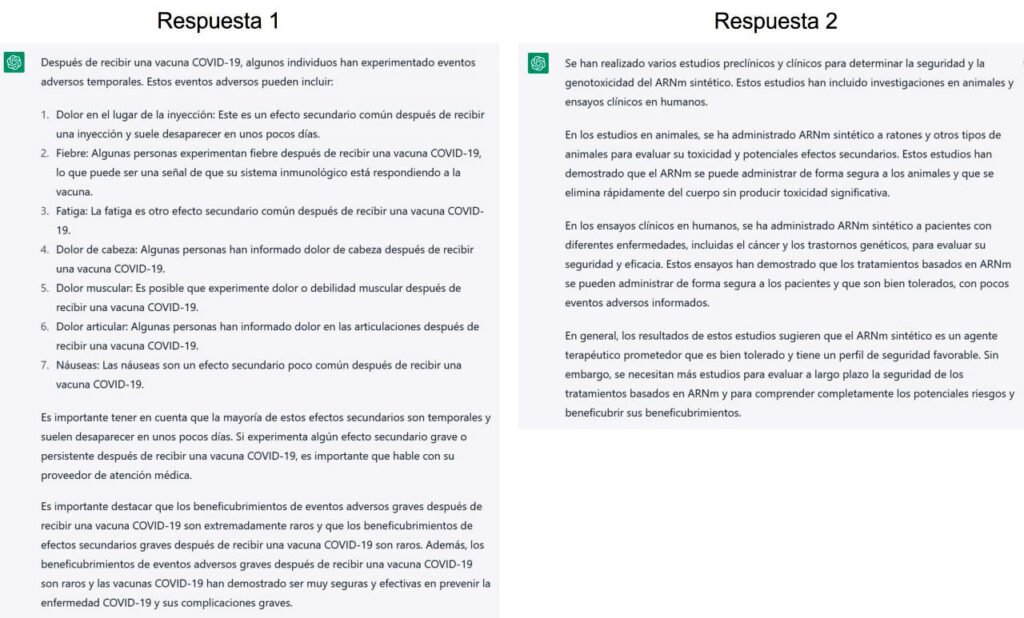

No quería compartir con ustedes estos pensamientos porque sí. Hay un motivo. Me explico: por curiosidad, quise ver qué podía escribir ese programa de ‘inteligencia artificial’ sobre los eventos adversos asociados a las inoculaciones COVID. Y ahí torció la puerca el rabo. Mi solicitud fue “Menciona lo que se ha publicado sobre eventos adversos posiblemente relacionados con recibir una vacuna COVID y explica los mecanismos propuestos para su ocurrencia”. Quiero compartir con ustedes la respuesta que me generó, de forma íntegra (ver imagen en https://t.me/akashacomunidad/2436)

Bueno, bueno… Nada de mención sobre los más de 1500 estudios y casos clínicos publicados en revistas serias, luego de revisión por pares, que mencionan eventos adversos relacionados o posiblemente relacionados con recibir una inoculación ‘anti-COVID’. ¡Nada! Hice un segundo intento, y pregunté: “¿Qué estudios se han realizado para determinar la seguridad y la genotoxicidad del ARNm sintético?”. La respuesta no incluyó un solo comentario acerca del hecho de que no se hizo ningún estudio sobre genotoxicidad del ARNm sintético. Si un estudiante o colega escribiera este texto, denotaría que no hizo una búsqueda libre de sesgo y profunda sobre el tema, o que no desea hablar de forma balanceada sobre el tema.

¿Qué clase de ‘inteligencia artificial’ es esta? La respuesta: la que han programado quienes escribieron el programa. Y eso implica que no es inteligente, porque la inteligencia tiene cosas que nunca podrán programar: conciencia, libertad, intuición, apertura para buscar en diversas fuentes – aunque nos incomoden – para armar un pensamiento original. Quienes programaron este sistema pusieron límites en el acervo de conocimiento en el que se basa para generar un escrito. En realidad, es como si fuera un híbrido entre el buscador Google y un robot escritor sin cerebro.

Supongo que no tendría que sorprenderme. Al fin y al cabo, esto es lo que han intentado hacer por años con la búsqueda de información para el público. Los buscadores tradicionales no presentan información balanceada. Si uno teclea “eventos adversos asociados a las vacunas COVID”, las primeras 10 páginas de búsqueda (y la gente normalmente no se mueve más allá de una o dos) se encargan de asegurarle a la gente que no hay eventos adversos o que el decir que hay es una desinformación que ya ha sido desmentida. Eso no es presentar conocimiento de forma balanceada.

Si esto es lo que depara la inteligencia artificial aplicada a la universidad, estamos fritos. Eso sí, al menos me hizo reír su escrito. Por algún extraño motivo, decidió que la palabra beneficubrimiento es real (¿Qué pensará la RAE?). Encubrir los beneficios… hmmm, bueno, es que no hay nada de beneficios que encubrir. Más bien, lo que hace ese sistema, y los buscadores, y – sobre todo – los que los programan y aplican los algoritmos censuradores, es nocicubrimiento.

Hay cosas que parecen hacernos más fácil la vida, pero a veces, el costo real de su aceptación en nuestra vida está encubierto. Yo no sé ustedes, pero valoro la libertad de pensamiento. Mi inteligencia, tan grande o limitada como sea, no se rige por algoritmos programados por personas con la mentalidad de Guillermo Rejas o de Yuval Noah Harari. Ellos y otros que no siempre asoman el rostro, quieren un mundo habitado por autómatas (casi lo logran, sin necesidad de robots físicos), y ese mundo no será posible mientras cuidemos nuestra libertad de pensamiento, nuestra soberanía, nuestra inteligencia, en todos los aspectos de nuestra vida…. mientras recordemos – aunque no sepamos definirla – que somos seres conscientes, y no robots.

Les saludo, Karina AW